编者按: 我们今天为大家带来的这篇文章,作者的观点是文本嵌入向量并非我们想象中的安全载体,在某些条件下,通过适当的技术手段可以高精度地还原出原始文本内容。 作者在本文介绍了其开发的...

编者按: 当你收到一篇由 AI 完成的文章时,是否也有过这样的困惑:内容看似专业严谨,读起来却总觉得缺少什么?明明语法正确、逻辑清晰,为什么就是无法抓住读者的注意力? 本文作者基于丰富...

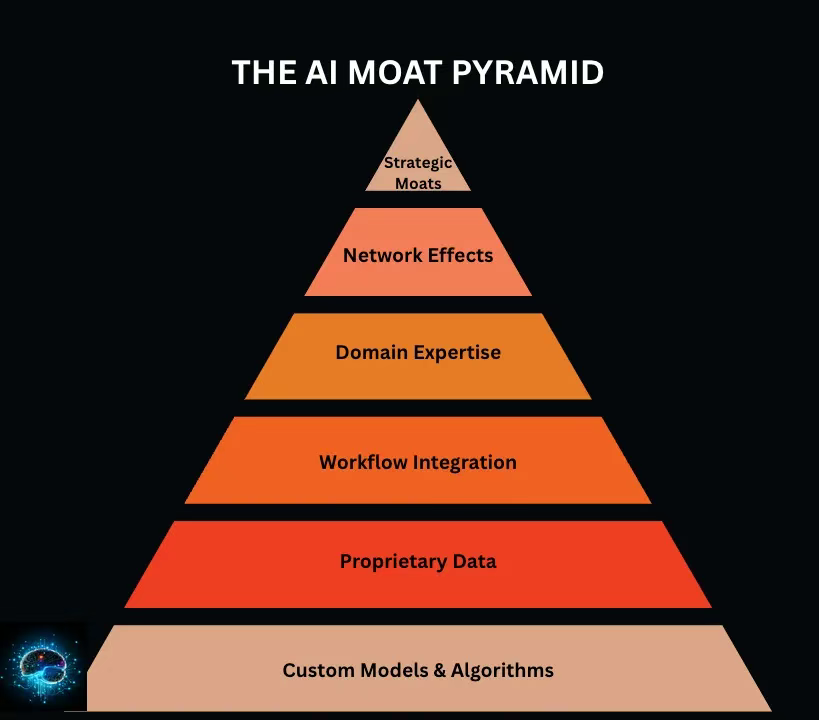

编者按: 我们今天为大家带来的文章,作者的观点是:真正的 AI 护城河需要系统性地构建六层递进式能力,从技术底座到战略壁垒,缺一不可。 文章提出了“AI Moat Pyramid”框架,详细阐述了六...

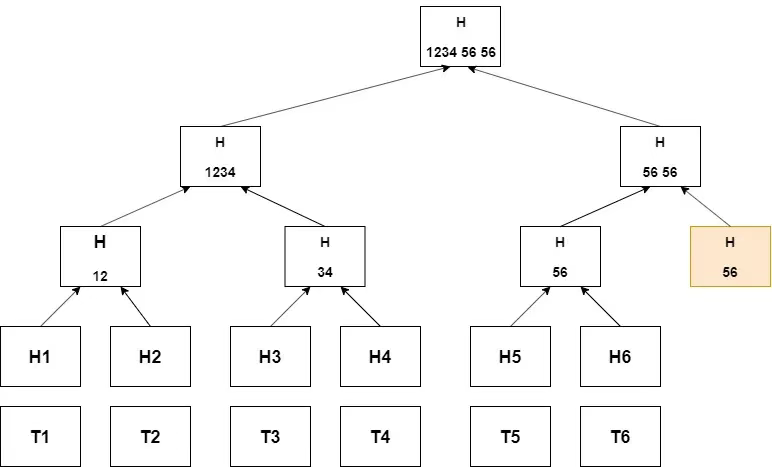

编者按: AI 编程工具如何迅速检索海量代码库,并精准定位到最相关的代码片段?这个看似不可能完成的任务,却是决定现代 AI 编程工具用户体验的关键技术挑战。 我们今天为大家带来的这篇文章...

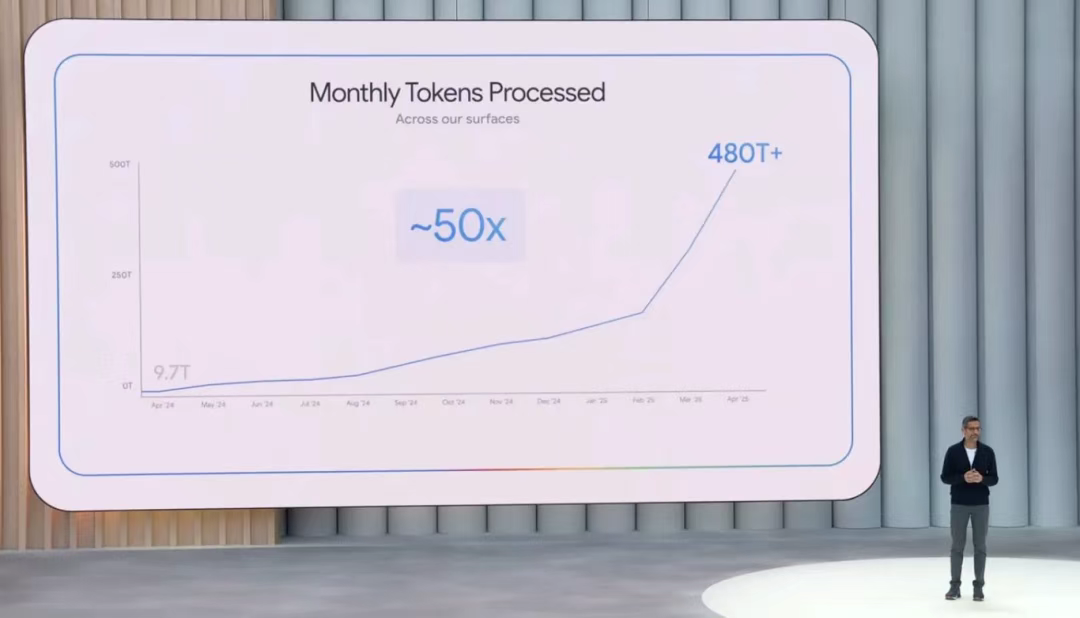

编者按: 人工智能真的已经深入我们的日常生活了吗?当我们还在讨论 AI 技术的潜力时,是否忽略了一个更为重要的事实 —— AI 的实际使用量可能远超我们的想象? 以 Google 为例,其 AI 交互...

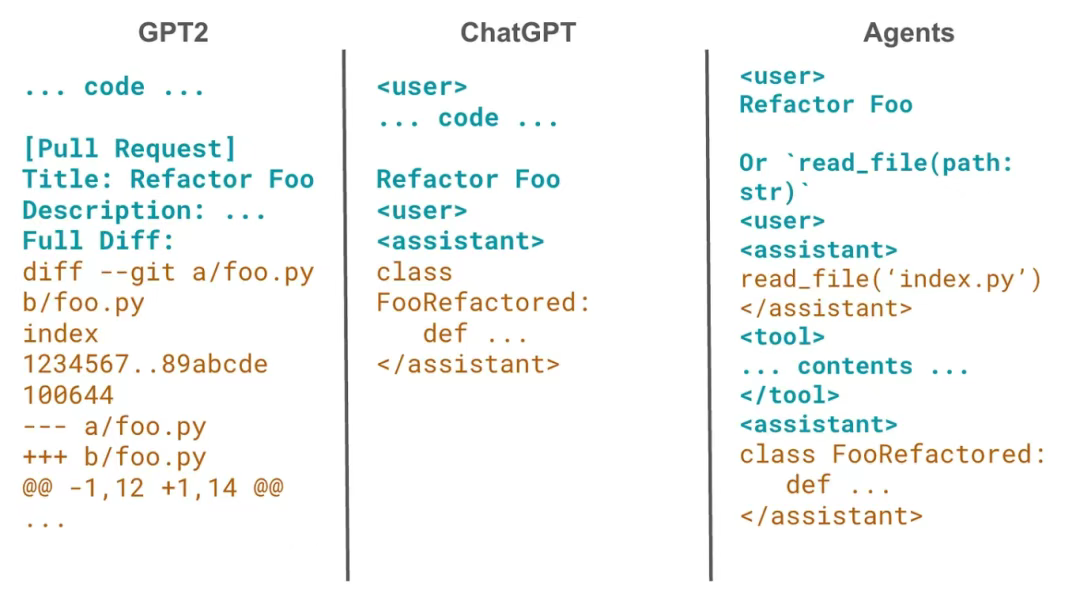

编者按: 我们今天为大家带来的这篇文章,作者的观点是:只有深入理解 AI 编程工具的底层原理和能力边界,才能真正驾驭这些工具,让它们成为提升开发效率的“外挂神器”。 本文从 LLM 的基础...

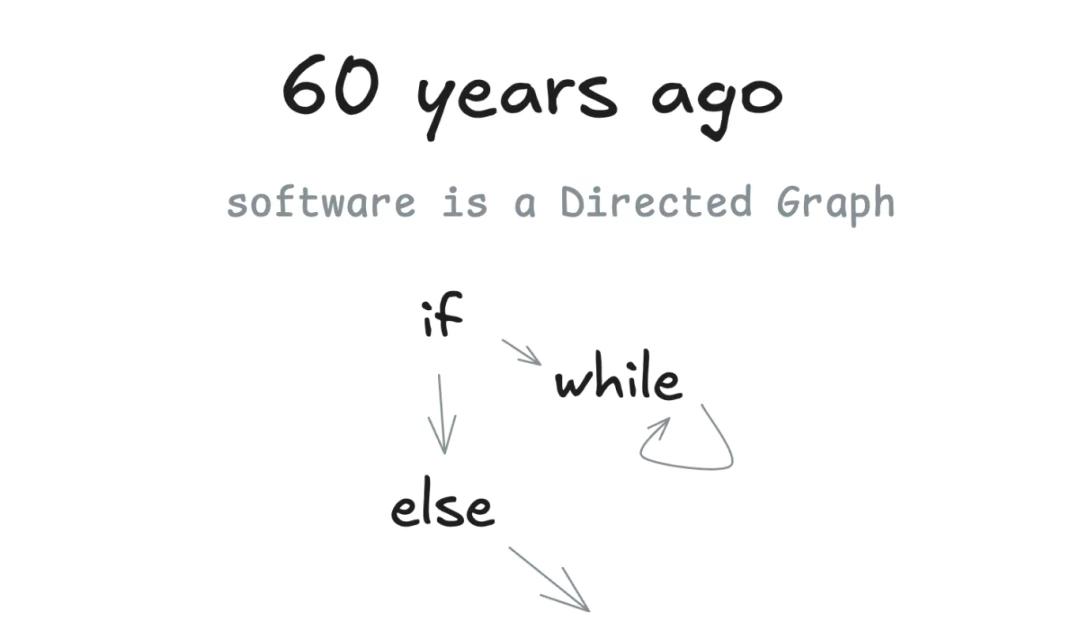

编者按: AI 智能体到底应该如何构建?是追求复杂的端到端解决方案,还是回归软件工程的本质思维? 我们今天为大家带来的文章,作者的观点是:智能体本质上就是软件,应该用严谨的软件工程原...

编者按: 当身边的人都在谈论 AI Agent 时,你是否会困惑:究竟什么才是真正的智能体?为什么 OpenAI、IBM 和各大技术领袖给出的智能体定义都不相同? 我们今天为大家带来的这篇文章,作者的...

编者按: 如何将 LLM 的推理过程从"烧钱的无底洞"转变为"高性能的生产力引擎"?本文深入剖析了提升 LLM 推理效率的五大核心技术:巧妙的 KV 缓存管理、Query-sparsity attention(QUEST)、推...

编者按: 本文首先解析了为什么 LLM 训练需要强化学习,详细讲解了 RL 和 RLHF 的工作原理;继而系统比较基于价值、基于策略和 Actor-Critic 三大强化学习范式的优缺点;最后深入剖析 TRPO 和...

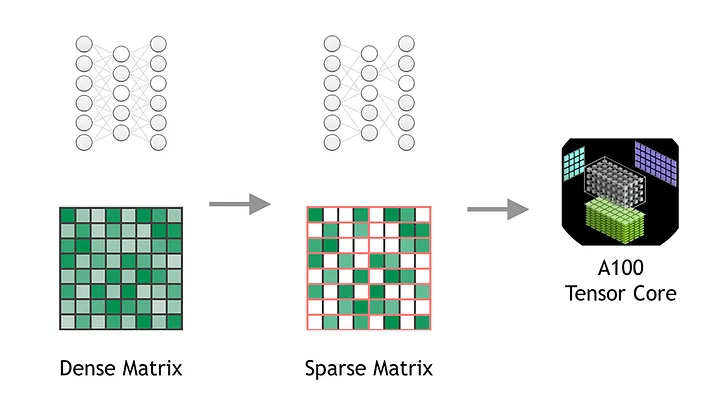

编者按: 近日,Qwen 3 技术报告正式发布,该系列也采用了从大参数模型中蒸馏知识来训练小参数模型的技术路线。那么,模型蒸馏技术究竟是怎么一回事呢? 今天给大家分享的这篇文章深入浅出地...

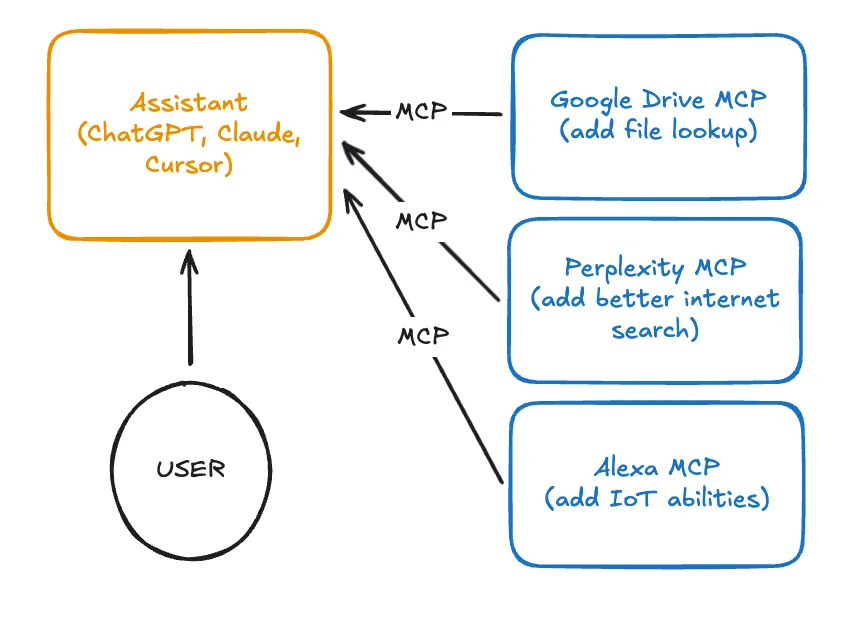

编者按: 模型上下文协议(MCP)究竟安全可靠吗?当你通过 MCP 插件让 AI Agent 访问公司文档、员工聊天记录或客户信息时,你真的了解潜在的安全风险吗? 文章详细剖析了 MCP 存在的四大问题...

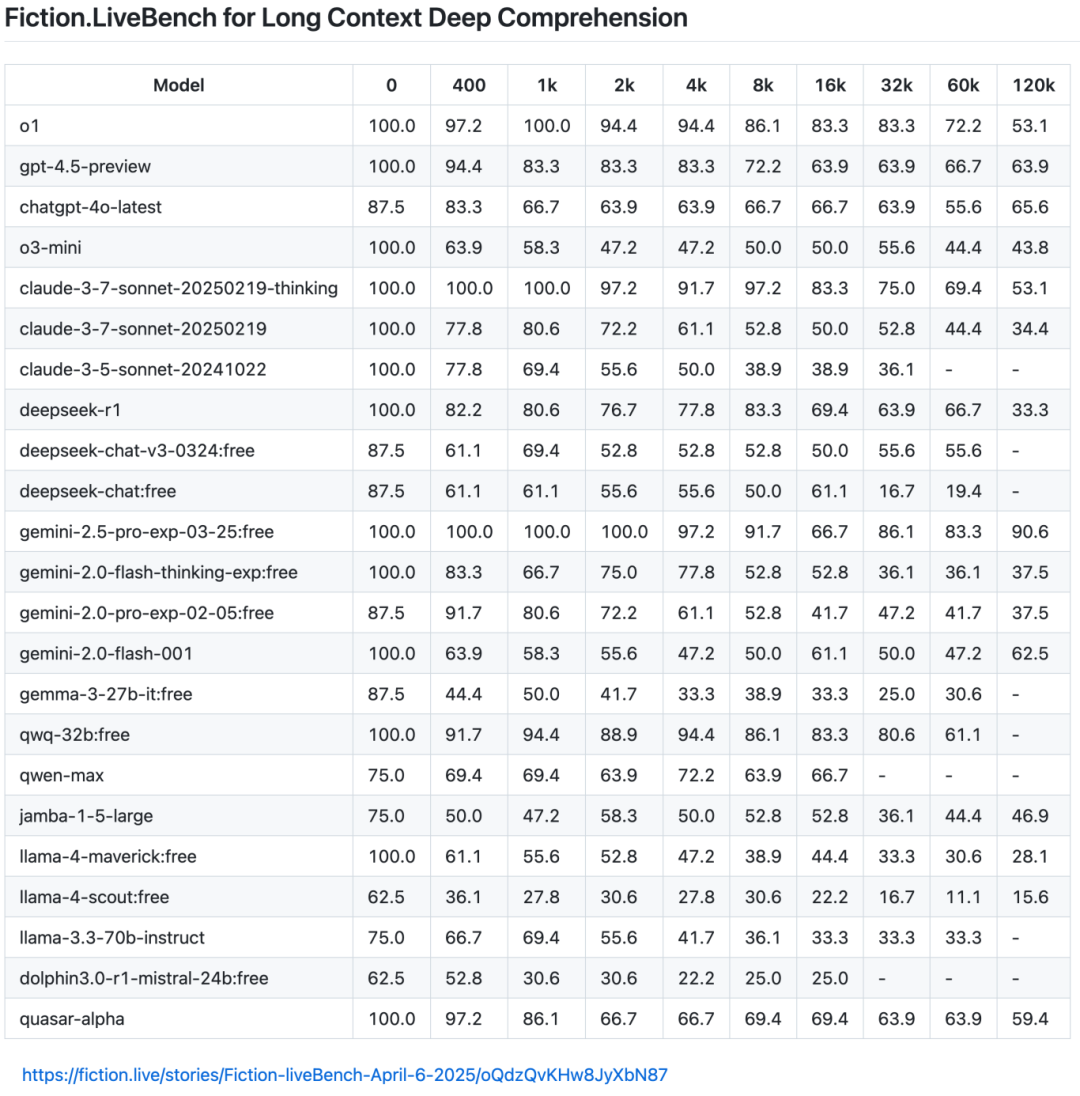

编者按: 我们今天为大家带来的这篇文章,作者的观点是:即便在大语言模型上下文窗口不断扩大的今天,检索增强生成(RAG)技术依然具有不可替代的价值。 文章首先通过 Fiction.liveBench 基准...

编者按: Google 新推出的 A2A 与 Anthropic 的 MCP 到底有何区别?它们是竞争关系还是互补的技术? 本文通过一个规划夏威夷旅行的生动案例,清晰拆解了这两大协议的本质区别:MCP 更像是为单...

编者按: 当前 AI 基础模型的商业前景正面临前所未有的挑战。开源模型的性能日益接近甚至在某些领域超越闭源产品,高昂的推理成本让订阅制模式的盈利空间被严重挤压,而价格战使 API 服务利润...

编者按: 这篇技术解析详细阐述了 DeepSeek-V3-Base 的预训练阶段所采用的关键技术。 文章重点介绍了三项核心技术:Document Packing 技术有效解决了输入序列长度差异导致的资源浪费问题;F...

没有更多内容

加载失败,请刷新页面

文章删除后无法恢复,确定删除此文章吗?

动弹删除后,数据将无法恢复

评论删除后,数据将无法恢复